들어가며

https://openai.com/product/gpt-4

GPT-4

GPT-4 is more creative and collaborative than ever before. It can generate, edit, and iterate with users on creative and technical writing tasks, such as composing songs, writing screenplays, or learning a user’s writing style.

openai.com

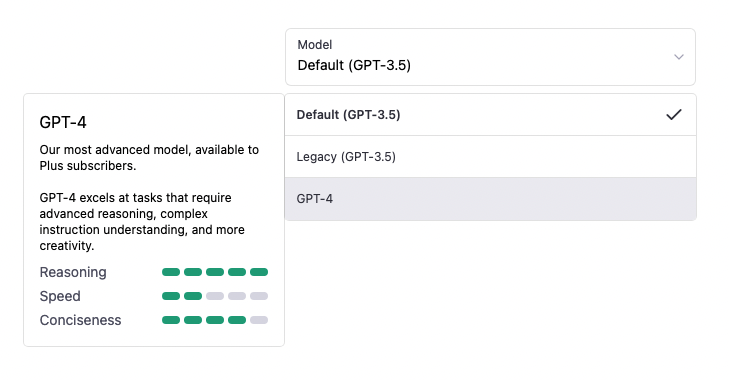

23년 3월 14일 GPT 4가 공개되었습니다. chatGPT가 세상을 씨게 한번 흔들어 놓은게 어제 같은데 openAI 참 일 잘하네요. GPT 4는 또 어떤 기능들로 세상을 놀라게 할 지 기대됩니다. 지난 chatGPT에서는 논문을 공개하지 않았는데 (엄밀히 말하면 GPT 3.5에 해당하는 instructGPT의 논문은 공개되어 있습니다. chatGPT는 GPT3.5 시리즈 중에 하나입니다.) GPT 4는 technical report 라는 이름으로 논문을 공개했습니다. 어디 학회에는 제출하지 않을거 같네요 ㅎㅎ

이번 포스팅에서는 GPT가 어떻게 발전해왔는지 간단하게 살펴보고, GPT 4에서는 무엇이 달라지는지 짚어보겠습니다. GPT4 논문 리뷰는 다음 포스팅에서 다뤄보겠습니다.

GPT 시리즈 타임라인

문득 궁금해져서 openAI의 GPT 시리즈가 어떻게 발전했는지 굵직한 타임라인을 정리해봤습니다. openAI는 GPT 시리즈 외에도 CLIP, dalle 등 컴퓨터 비전 분야 연구로도 유명한데 언제 이 눈부신 연구들을 했는지 참 대단하네요.

지금의 GPT 시리즈의 모태가 되는 논문인 "Improving Language Understanding by Generative Pre-Training"은 2018년 6월에 공개되었습니다. 저자는 Alec Radford입니다. DCGAN 1 저자였으며 이후 GPT 2, Clip 등 굵직한 논문들을 쓴 AI 히어로입니다. (구글 에 검색하면 바로 나오는데 찐천재의 비주얼은 이런거구나... 싶습니다.)

GPT인 이유는 첫 논문의 제목에서 Generative Pre-Training의 앞글자를 따서 GPT입니다. GPT 1에서는 대량의 unlabeld corpus를 비지도학습 방식으로 decoder only transformer를 학습시킨 뒤, 문장 분류, 문장 유사도 계산 등의 downstream 테스크에 fine-tuning하는 방식을 제안하였습니다.

GPT 2에서는 downstream task에 대해서 fine-tuning할 것 없이 바로 모델을 downstream 테스크에 적용해보는 시도를 하게 됩니다. GPT 2는 15억개의 파라미터를 사용하였습니다. 그 뒤 GPT 3에서 무려 1750억개의 파라미터를 가진 GPT 3 175B을 선보였습니다. 이 초거대 언어 모델은 prompt learning이라는 그냥 어떤 테스크를 수행하면 되는지 입력에 넣어주기만 하면 알아서 척척해내는 위용을 보여주며 세상을 들썩이게 했습니다.

그 뒤로도 거대 언어 모델(LLM) 트랜드는 이어졌습니다. LLM을 기반으로 코드를 생성해주는 codex와 github copilot을 선보이며 LLM을 실용적으로 활용할 수 있는 사례를 만들었습니다. 그 뒤, InstructGPT에서는 언어 모델이 더 사람같은 응답 텍스트를 생성할 수 있도록 사람의 응답에 기반한 강화학습 기법을 학습합니다. (Reinforcement Learning from Human Feedback).

이 후, openAI는 강화학습 기법으로 대화 성능을 끌어올린 GPT를 chatGPT라는 이름으로 오픈 베타를 시작합니다. 누구나 공짜로 거대 언어 모델과 대화할 수 있는 인터페이스를 제공하였습니다. 그러면서도 유해 컨텐츠 생성으로 인한 잡음이 없었고, MAU 1억에 달하는 트래픽을 받으면서도 지연이나 장애없이 서비스를 운영했습니다. 많은 사람들이 chatGPT의 성능에 놀랐고, 이를 자신들의 비즈니스에 접목시키려는 시도들이 이어졌습니다.

chatGPT 열풍에 힘입어 GPT 4가 발표되었습니다. 그렇다면 GPT 4에서는 어떤 변화들이 있는지 알아보겠습니다.

GPT 4 주요 변화

1. 더 창의적이다.

GPT 4는 유저와 협동하여 대본을 쓰거나 작사를 할 수 있다고 합니다. 그리고 유저의 글쓰기 스타일을 파악하여 협업한다고 합니다. 곧 작가들을 위한 copilot이 등장할 것 같네요.

위 예제는 신데렐라 이야기를 알파벳 A부터 Z까지 순서대로 사용하면서 요약해보라는 질문을 던졌을 때의 결과입니다. 진짜 신기하네요. 저 테스크를 수행할 수 있는 인간이 있는지, 있다면 얼마나 시간이 걸리는 작업인지를 생각해보게 합니다.

2. 이미지를 입력으로 받을 수 있다.

GPT 4는 텍스트와 이미지를 모두 입력으로 받을 수 있습니다. 위 예제에서는 이미지와 함께 이미지 속 재료들로 만들 수 있는 음식을 물어보면 음식 종류를 말해줍니다. 그 외에도 이미지를 분류하거나 캡션을 달아주는 일들을 해줄 수 있습니다. 개인적으로는 GPT 4의 가장 큰 변화였습니다.

3. 더 긴 문맥을 파악할 수 있다.

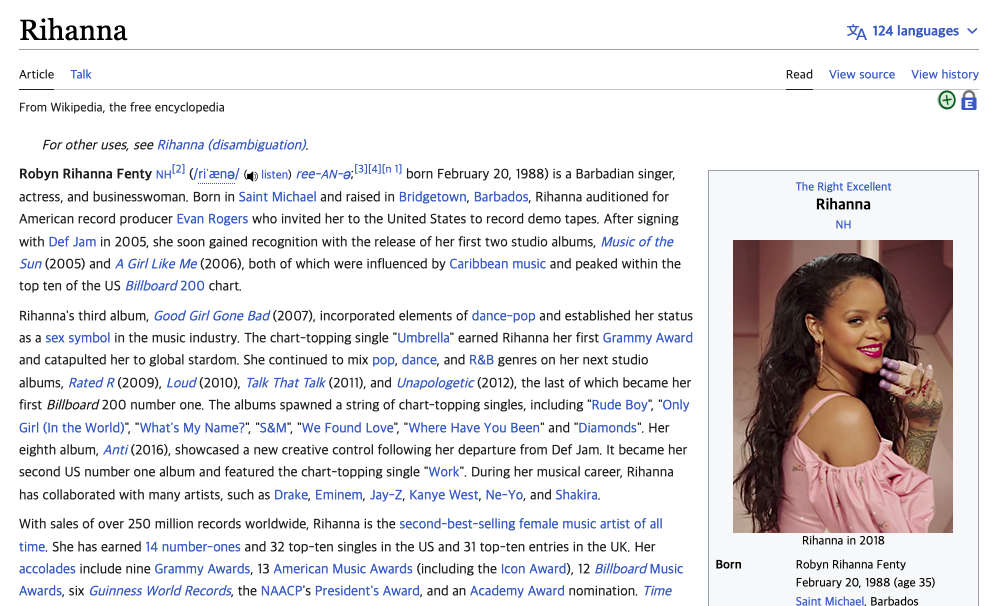

GPT 4는 더 긴 문맥을 파악할 수 있다고 합니다. 긴 문서를 입력으로 받아서 질문에 대답을 하거나 요약을 해주는 등의 기능을 제공할 수 있어 보입니다. 위 예제에서는 리한나의 위키피디아 문서를 읽고 그녀의 슈퍼볼 퍼포먼스에 대해서 설명하라는 질문을 합니다.

리한나 위키피디아를 보면 텍스트가 빼곡합니다. 그 중에서도 슈퍼볼 공연에 관련된 부분은 문서 중반부에 있습니다. 즉, GPT가 답변을 생성할 때, 저 수많은 텍스트를 입력으로 받아 생성이 가능하다는 것을 말합니다. 꽤나 놀라운데, 기업의 사내 문서 검색 등에 적용하면 강력할 것 같습니다. 또 빙 서치엔진에 들어간 GPT의 경우 답변 생성을 서치엔진에 걸린 문서들의 텍스트를 입력으로 함께 받아서 생성할 수 있을 것 같습니다. (이미 그러고 있을듯 ㅎㅎ)

4. 더 똑똑하다

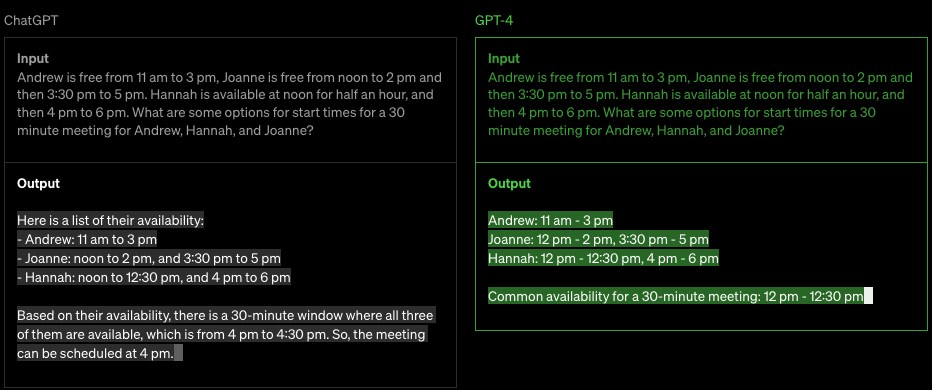

GPT 시리즈의 놀라운 부분은 언어 모델을 학습시켰는데 이 녀석이 가르치치도 않은 추론 능력을 갖게 된 것입니다. 예를 들어 텍스트를 생성하도록 학습을 시킨건데 논리 문제를 풀고 수학 문제를 증명하기도 합니다. GPT 4에서는 이런 추론 능력을 향상시켰다고 합니다.

위 예제에서는 간단한 논리 문제를 내주었는데, chatGPT는 시원하게 틀린 반면 GPT 4는 깔끔하게 맞췄습니다.

여러 시험들에서도 GPT4가 각각 상위 10%, 상위 1%에 들면서 놀라운 성적을 거둔 것을 볼 수 있습니다. 이제 정말로 인간보다 똑똑한 AI라 할 수 있겠습니다.

5. 더 안전하다.

내부 테스트 결과 GPT 4는 GPT3.5에 비해 유해 컨텐츠 요청들에 대해 82% 더 응답을 하지 않고, 40% 더 팩트에 기반한 응답을 생성한다고 합니다. 그리고 각 도메인의 전문가 50명을 포함한 사람들의 피드백을 받아서 계속해서 학습을 진행한다고 합니다.

마치며

지금까지 GPT의 대략적인 변천사와 이번에 출시된 GPT 4의 기능들에 대해서 알아봤습니다. 한번 살펴보는 것만으로도 영감이 자극되네요. 몇 가지 아이디어를 테스트 해보고 싶어서 chatGPT plus를 결제하고 오는 길입니다 ㅎㅎ 흥미로운 발견을 하게 되면 또 포스팅으로 공유하겠습니다.